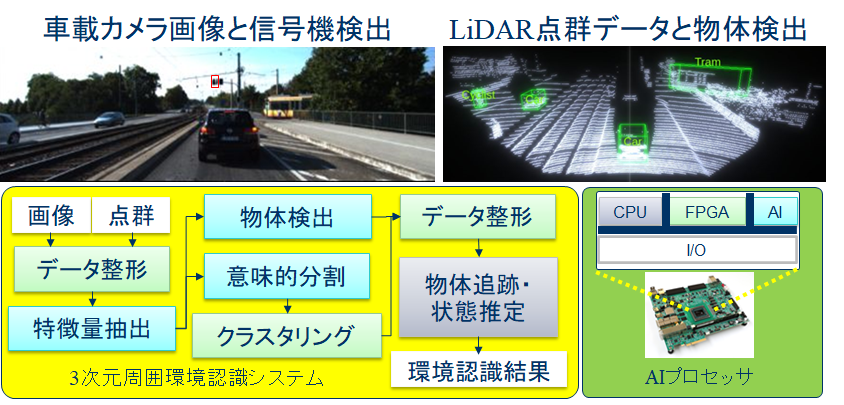

□ 自動運転用周囲環境認識組込みAIシステム

|

[ 概要 ]

車両を自動で運転するには周囲の環境をリアルタイムで認識する必要があります.右図はカメラ画像と,レーザーが物体に当たって戻って来るまでの時間から距離を測定するLiDARというセンサーから得られた点群を入力して,周囲の環境を認識する処理の流れを表しています.周囲の車両や歩行者などの移動物体を検出して追跡したり,道路や歩道を認識して走行可能なスペースを判断したりするには,高い計算能力が必要です.一方,バッテリー容量には限りがあり,車両に大きなPCを搭載することはできません.そこで我々は自動運転向けの周囲環境認識をリアルタイムで行う低電力な組込みAIシステムを開発しています.

|

|

|

□ オプティカルフローを用いた点滅領域検出

|

[ 概要 ]

点滅領域は,他運転者の意図を把握し,道路状況に応じた自動運転車の行動を決定するために有用です.従来,点滅領域の検出はカメラ画像に写ったウィンカーや点滅信号機など点滅の種類ごとに個別に行われていました.このアプローチでは物体の検出が失敗したり対象に含まれなかったりした場合には点滅現象を検出できません.そこで我々はオプティカルフローを用いて過去の画像を現在の画像に位置合わせして差分を取ることにより点滅を検出する方法を提案しています.実験の結果,提案法は物体の種類を限定することなく,物体の一部しか撮影されていない場合でも,点滅を検出できました.

図:右前方トラック右折ウィンカーの点滅検出・追跡

(左上)時刻t画像 (中上)オプティカルフロー (右上)点滅検出・追跡

(左下)時刻t+1画像 (中下)予測画像 (右下)差分画像

|

|

|

□ 意味分割・動き推定・視差推定を同時処理するCNNのハードウェア化

|

[ 概要 ]

現在,CNN(Convolutional Neural Network:畳み込みニューラルネットワーク)による画像認識技術が急速に発展しています.意味分割は画像を物体種類毎に画素単位で分割します.動き推定は時間的に連続した2枚の画像中の画素の対応付けを行います.視差推定は動き推定の一種で左右ステレオ画像を対象とします.これらは画像認識の一種であり,自動運転に不可欠なSLAM(Simultaneous Localization and Mapping:自己位置推定と環境地図作成の同時実行)の基礎となります.当研究室ではこれらを同時処理するCNNのハードウェア化に取り組んでいます.

図:Drivingデータセット

(左)画像 (中)視差 (右)動き

|

|

|

□ アフィン動き分割VLSIプロセッサの開発

|

[ 概要 ]

動き分割は動画中の同じ動きを持つ画素を集めて領域を生成します.アフィン動き分割は,領域ごとにアフィン動きモデルを推定し,動きの一致する動きモデルを持つ領域に画素を割り当てます.左の動画はこの処理の適用例であり,交差点を行き交う車両が動きの違いにより分割され,推定された動きモデルを使用して追跡されています.我々は動きモデル推定と領域境界更新の繰り返しを頻繁に行う収束の速い新しいアルゴリズムと,これを効率的に実行する専用パイプラインプロセッサを開発し,CMOS 0.18 umプロセスのスタンダードセルを用いてVLSIに実装しました.

|

|

|

□ 実時間頭部姿勢推定システムの開発

|

[ 概要 ]

頭部姿勢推定とは,人が右,左,上,下など向いている方向をコンピューターが読み取る技術です.人が向いている方向をコンピューターが読み取ることができれば,車の余所見運転に対し警報を鳴らす余所見運転防止や,ポインティングデバイスとしてのユーザーインタフェースや,”あっち向いてホイ”のようなゲームに応用できます.また,顔器官の位置推定は表情認識にも有用です.そこで我々はFPGAボードを用いた実時間で動作する頭部姿勢推定システムを開発しています.

|

|

|